Las imágenes de entrada son archivos RGB (como JPEG o TIFF) o RAW de cámara. Ambos almacenan información visual como una combinación de colores primarios (por ejemplo, rojo, verde y azul) que juntos describen una emisión de luz para ser recreada por una pantalla.

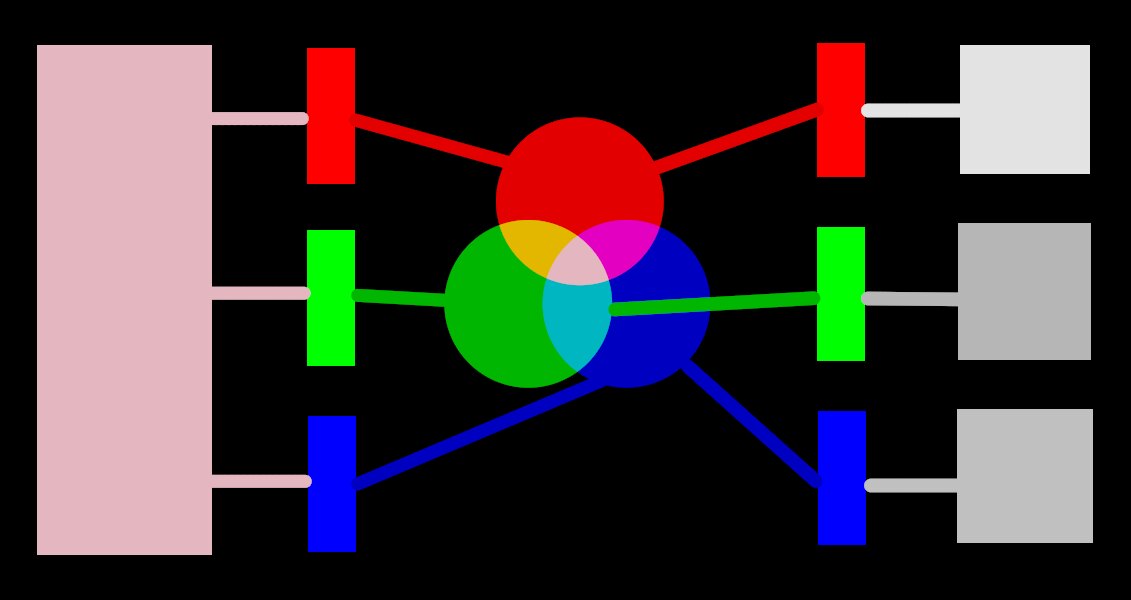

La siguiente imagen ilustra este concepto.

El lado izquierdo de la imagen muestra una luz de color que necesitamos representar digitalmente. Podemos utilizar tres filtros de color ideales para descomponer esta luz en tres luces primarias de colores a diferentes intensidades. Para recrear la luz de color original de nuestra descomposición ideal (como se ilustra en el centro de la imagen) simplemente necesitamos recombinar esas tres luces primarias por adición.

Debería ser posible reproducir la luz de color original tomando un conjunto de luces blancas con las intensidades correctas y proyectando esas luces a través de filtros de colores apropiados. Este experimento se puede realizar en casa utilizando geles y bombillas blancas regulables. Esto es más o menos lo que hacían las antiguas pantallas CRT en color y es la forma en que todavía funcionan los proyectores de vídeo.

In photography, the initial decomposition step is performed by the color filter array that sits on top of your camera’s sensor. This decomposition is not ideal, so it isn’t possible to precisely recreate the original emission with simple addition – some intermediate scaling is required to adjust the three intensities.

En las pantallas, las bombillas LED se atenúan proporcionalmente a cada intensidad, y las emisiones de las tres luces se suman físicamente para reconstruir la emisión original. Las imágenes digitales almacenan las intensidades de estas luces primarias como un conjunto de tres números para cada píxel, representados en el lado derecho de la imagen de arriba como tonos de gris.

While a set of display intensities can be easily combined to recreate an original light on a screen (for example, if we created a synthetic image in-computer) the set of captured intensities from a sensor needs some scaling in order for the on-screen light addition to reasonably reproduce the original light emission. This means that every set of intensities, expressed as an RGB set, must be linked to a set of filters (or primary LED colors) that define a color space – any RGB set only makes sense with reference to a color space.

No solo necesitamos reconsiderar las intensidades capturadas para hacerlas sumables nuevamente, sino que si vamos a recomponer la luz original en una pantalla que no tiene los mismos filtros de colores o primarios que el espacio al que pertenece nuestro conjunto RGB, estas intensidades es necesario reescalarlas para tener en cuenta los diferentes filtros en la pantalla. El mecanismo para esta escala se describe en perfiles de color, normalmente almacenados en archivos .icc.

Nota: El color no es una propiedad física de la luz – existe solo en el cerebro humano, como producto de la descomposición de una emisión de luz por las células del cono en la retina, de nuevo muy similar en principio al anterior ejemplo de filtrado. Un valor “RGB” debe entenderse como “emisiones de luz codificadas en 3 canales conectados a 3 primarios”, pero los primarios mismos pueden verse diferentes de lo que los humanos llamarían “rojo”, “verde” o “azul”.

Los filtros descritos aquí son filtros de paso de banda superpuestos. Dado que se superponen, sumarlos nuevamente no preservaría la energía del espectro original, por lo que (para abreviar) debemos reducirlos con respecto a la respuesta del cono de retina

La mayor parte del procesamiento de imágenes real de Ansel tiene lugar en un gran espacio de “perfil de trabajo” RGB, con algunos módulos (en su mayoría más antiguos) trabajando internamente en el espacio de color CIELab 1976 (a menudo llamado simplemente “Lab”). La salida final de la tubería de procesamiento de imágenes se encuentra una vez más en un espacio RGB con forma para la pantalla del monitor o el archivo de salida.

This process implies that the pixelpipe has two fixed color conversion steps: input color profile and output color profile. In addition there is the demosaic step for raw images, where the colors of each pixel are reconstructed by interpolation.

Cada módulo tiene una posición en el pixelpipe que le indica en qué espacio de color vive el módulo:

Up to demosaic : The raw image information does not yet constitute an “image” but merely “data” about the light captured by the camera. Each pixel carries a single intensity for one primary color, and camera primaries are very different from primaries used in models of human vision. Bear in mind that some of the modules in this part of the pipe can also act on non-raw input images in RGB format (with full information on all three color channels).

Between demosaic and input color profile : Image is in RGB format within the color space of the specific camera or input file.

Between input color profile and output color profile : Image is in the color space defined by the selected working profile (linear Rec2020 RGB by default). As Ansel processes images in 4x32-bit floating point buffers, we can handle large working color spaces without risking banding or tonal breaks.

After output color profile : Image is in RGB format as defined by the selected display or output ICC profile.